本项目是北京市科技计划课题(批准号: D161100001816001), 起 止 时 间 为2016年1月至2017年12月,已于2018年3月通过北京市科技委员会验收。在项目执行期间,按照研究 计划,从五个方面开展研究,一是执行听视觉感知技术研究,主要实现场景分类、物体识别、视觉场景内的区域级解析、室内环境的立体建模、 语音的识别、异常声音的检测,同时建立视觉知 识库进行更全面和深入的场景理解,实现更综合 的视觉场景描述;二是执行机器人路径规划,保证机器人在运行环境中能够安全、快速地移动到目标点。路径规划包含基于地图的导航规划(全局路径规划)与基于传感器的反射式导航(局部 路径规划);三是利用家人个性化知识、生活常 识知识进行推理学习和知识建模,以便对生活习惯进行自主学习;四是机器人控制系统将视觉环 境感知的结果滤波及预测,通过手眼协调来完成 物体抓取;五是关于语言与视听觉场景的多模态 信息理解、用户的意图感知、多模态的知识推理、 语音与视觉的自然对话、行为与语言的融合交互 的研究。

技术创新:在人机交互方面,提出一个双轨多模态自学习模型。创新之处在于将视觉识别和自动知识提 取有机融合到到一个统一的框架中,实现了视觉识别与知识学习的关联增强。双轨多模态自动学习模型由两部分组成:混合增量学习和来自知识轨道的多模态知识抽取。通过学习新的对象样本和新的对象概念,可以提高系统的识别能力;通过集成多模态信息,知识抽取能够根据识别的物 体构建和持续更新知识条目,两个模态互相融合, 形成一个整体的系统。 在图像的概念分类方面,采用多特征和空间 上下文的方法,在大规模的图像数据集上得到了 与卷积神经网络相当的性能;提出了面向场景分 类的多尺度深度模型的融合方法,并在大规模场 景分类数据集 SUN397 上得到了同时期最好性能。 在手持物体识别方面,提出了有针对性的多特征融合技术,发表了5篇论文,开发了原形演示系统,并在国际会议 ACM Multimedia 上进行了演示。 在 RGB-D 的概念识别方面,研究了利用弱监督学习的方法的 Depth 图像表示问题,取得了 比从 RGB 模态上迁移过来的特征表示更好的结果。

论文发表和专利申请:在项目执行期间,共录用发表学术论文 11 篇,申请发明 专利 2 项。

人才培养:项目组培养博士研究生6名,硕士研究生10余名。

数据库建设建立了复杂场景下的实例级图像数据集 INSTRE、基于多传感器的手持物体检测数据集 HOD 等,这些数据集可以支持和推动相关领域的进一步研发。

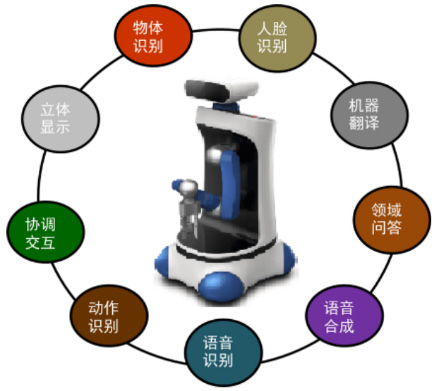

图 1: 结构展示 图 2:功能展示